El fin de la realidad

¿Qué son los «deepfakes»?

septiembre 2020

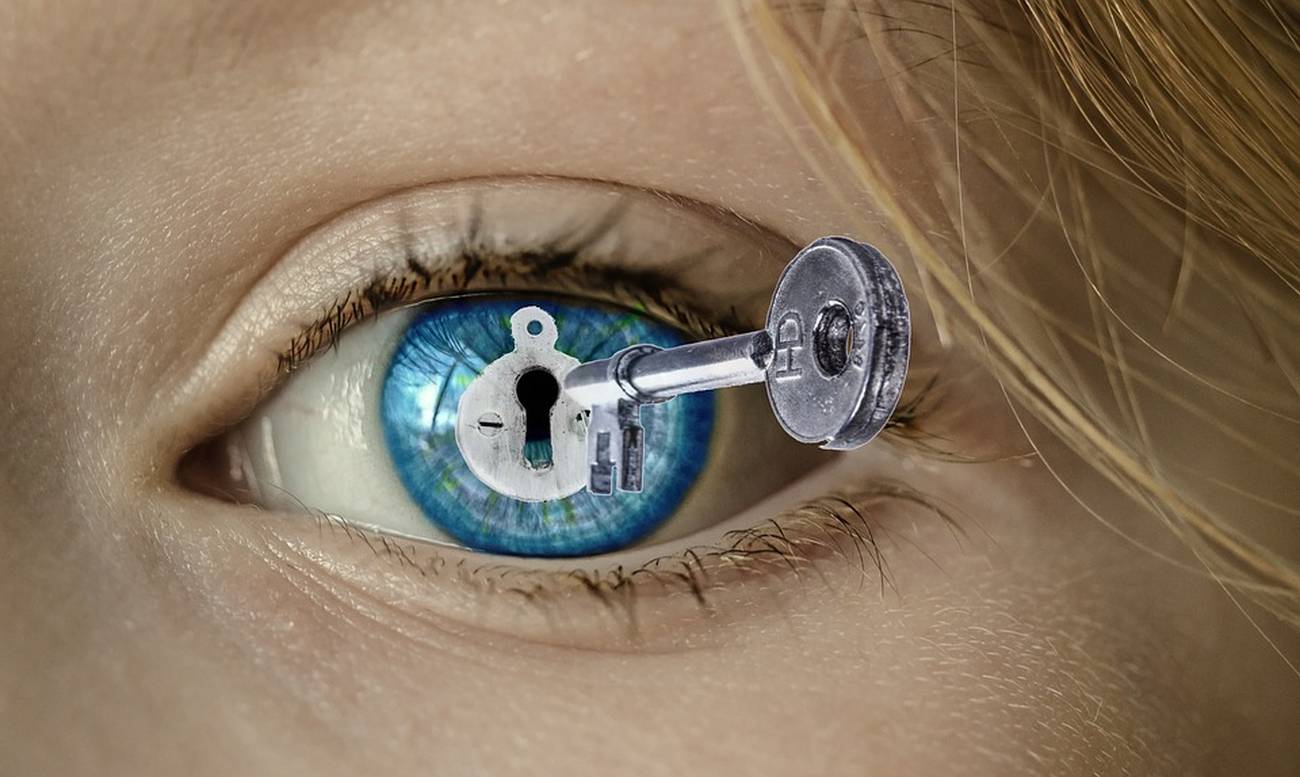

La izquierda quería transformar la realidad. La tecnología ha ayudado a burlarla. La inteligencia artificial ha permitido que un político de la India hable idiomas que no habla, ha conducido a la creación de videos pornográficos falsos de celebridades mundiales y hasta ha colaborado a que en Gabón (donde se dio por enfermo al presidente) se produzca un fallido golpe de estado. A través de los deepfakes, Internet está diseminando una nueva amenaza fantasma: que, a través de la imitación de rostros y sonidos de las personas, nunca más sepamos qué es verdad. La realidad está siendo hackeada.

En menos de seis años, el desarrollo de la inteligencia artificial puso a disposición de casi cualquiera la posibilidad de crear imágenes falsas indistinguibles de la realidad. Del negocio del porno a un golpe de Estado en Gabón, la internet está diseminando una nueva amenaza fantasma: que nunca más sepamos qué es verdad.

En las últimas elecciones legislativas de Nueva Delhi, el candidato Manoj Tiwari sorprendió a sus electores con un video hablando en hindi, otro en inglés y otro en haryanvi. Antes de ser la principal figura del Partido Popular Indio (BJP, por sus siglas en hindi) en la capital del país, Tiwari fue actor, cantante popular y estrella de un reality show, pero nadie sospechaba que hablara en inglés (capital valioso para las clases urbanas) y mucho menos el dialecto de la zona de Haryana. Días después se supo la verdad: una agencia publicitaria le había propuesto al BJP, al cual pertenece el primer ministro Narendra Modi, ampliar la oferta electoral utilizando inteligencia artificial para crear deepfakes de Tiwari. Con grabaciones anteriores y software de punta, pusieron en su boca palabras que desconocía y llevaron su mensaje por WhatsApp a votantes fuera de sus núcleos de apoyo. No es la primera vez que un candidato imposta su voz para acercarse a nuevos conciudadanos. Ni la primera que se utiliza inteligencia artificial en política. Sí, hasta donde se sabe, es la primera vez que un candidato cambia su propio cuerpo y voz con deep learning para mejorar su performance.

Los deepfakes aparecieron por primera vez en 2017, uno de los años del boom de las fake news. El usuario de reddit /r/deepfakes publicó sus primeras creaciones pornográficas utilizando algoritmos y librerías de imágenes de libre acceso con resultados asombrosos. En sincronía con la aparición de TikTok y las apps de envejecimiento o rejuvenecimiento facial, la técnica de este usuario anónimo se popularizó y pronto surgió la primera app abierta para incorporar un rostro cualquiera a un video existente. Desde Bolsonaro como el Chapulín colorado hasta Cristina Kirchner como una Drag Queen de Ru Paul, Internet se llenó de videos con propósitos básicamente humorísticos, aunque la abrumadora mayoría seguían siendo pornográficos. Lo más notable, a tres años de su aparición, es la mejora de su calidad. En agosto, un fan publicó su propia versión de las escenas de Robert De Niro joven en The Irishman. La comparación entre el trabajo de CGI de Netflix y el deepfake de este usuario de YouTube (y los millones de dólares de diferencia) da la pauta de la accesibilidad y potencial eficacia de esta herramienta.

Para estas creaciones se utiliza un autocodificador, que crea una imagen latente con solo algunas variables (parámetros de sonrisa, ceño fruncido, etc.) y repone con otras la imagen final (los mismos gestos con otro rostro, o el mismo rostro con otro discurso, por ejemplo). Pero no estamos hablando solo de imágenes fijas o en movimiento, sino también de sonido. La falsa primicia basada en un audio viral sobre el supuesto pase de Lionel Messi al Manchester City podría haber prescindido de un imitador talentoso. El audio bien podría haberse creado con un software como el que utiliza el Boston Chlidren’s Hospital para reecrear la voz de quienes perdieron el habla. En septiembre se conoció la primera gran estafa de un deepfake: según el Wall Street Journal, el CEO de una compañía inglesa transfirió 220.000 euros por orden de un software que imitaba la voz de su jefe alemán.

La mera existencia de esta tecnología no solo habilita la posibilidad de crear fakes -con consecuencias políticas y sociales inusitadas- sino desbancar a la realidad de su status: si lo que existe realmente puede ser adulterado o directamente inventado, todo el mundo tiene derecho a desconfiar. El ejemplo más paradigmático de este problema, relató Rob Toews en la revista Forbes, ocurrió en Gabón. Durante largos meses de 2018, su presidente, Ali Bongo, no apareció públicamente. Los rumores sobre su estado de salud e incluso su muerte obligaron al gobierno a revelar que Bongo había sufrido un accidente cerebro vascular, pero que estaba recuperándose y que daría un discurso para Año Nuevo. La rigidez y aparente artificialidad de los movimientos del líder en el mensaje grabado rápidamente despertaron la psicosis de la oposición: el video es falso, exclamaron. Una semana después, y apoyándose en la aparente acefalía, una fracción del Ejército quiso dar un golpe de Estado en Gabón, aunque luego fue reprimido... por el propio Bongo, que sigue al frente del gobierno. El video no había sido alterado.

Nada más que la verdad

La pandemia llevó nuestra relación con las imágenes virtuales a niveles insospechados. Entrevistas laborales, clases, bautismos, consultas médicas, audiencias judiciales, sesiones legislativas, y hasta sexo. La «presencia» es un requisito cada vez más prescindible en los rituales e instituciones que nos constituyen como sociedad. A la inversa, la identidad virtual, su «huella digital», se vuelve cada vez más relevante, y no solo en términos jurídicos sino también prácticos. Allí donde la vida cotidiana encuentra su cauce solo a través de una proyección digital, su autenticación es vital. Lo saben los niños de todas las latitudes que, igual que el senador argentino Esteban Bullrich lo hiciera en el Congreso, ya aprendieron a burlar a sus profesores poniendo imágenes en loop en una clase virtual.

Los deepfakes presentan problemas más complicados. La inteligencia artificial (IA) ya se utiliza en la creación masiva de comentarios para posicionar un producto o servicio en plataformas de e-commerce, y también para fines políticos, como se comprobó durante la campaña presidencial argentina en 2019. ¿Por qué no imaginar protestas o movilizaciones masivas, ejecuciones sumarias, represiones, crímenes callejeros y demás registros visuales inventados? Si las «campañas de desprestigio”» son ya una herramienta consolidada, tanto para quienes la ejercen como para quienes la enarbolan como excusa, ¿qué posibilidades abren los deepfakes? ¿Qué niveles de miseria política puede arrastrar la posibilidad de que un registro visual sea falso?

Según un un análisis del Crime Science Journal, los deepfakes con propósito criminal son el delito basado en inteligencia artificial con mayor poder de daño (o lucro) de su especie y el más difícil de derrotar. Entre sus modalidades se encuentran la falsificación extorsiva de secuestros mediante la imitación de voz o imagen en video, la imitación por voz para acceder a sistemas seguros y una amplia gama de extorsiones con videos falsos.

Estas preocupaciones ya dispararon algunas reacciones. China prohibió la difusión de deepfakes sin su correspondiente advertencia y el Estado de California prohibió su utilización con fines políticos en periodos electorales. En octubre, Facebook creó un fondo de 10 millones de dólares para desarrollar herramientas que detecten rápidamente las imágenes falsas. Microsoft, por su parte, acaba de presentar su «Video Authenticator», una herramienta para detectar deepfakes. E incluso apareció Sensity, la «primera compañía de inteligencia sobre amenazas visuales», que combina monitoreo y detección algorítmica de deepfakes.

Según Sensity, hasta julio de 2019 había menos de 15.000 deepfakes circulando por la web. Un año después, la cifra creció a casi 50.000. El 96% son pornográficos y en lo que va de 2020 ya se subieron más de mil deepfakes por mes solo en sitios de porografía, donde aparecen con cada vez más frecuencia supuestos «videos prohibidos» de celebridades e influencers. «Las compañías detrás de la web porno no consideran que esto sea un problema», le dijo a Wired el CEO de Sensity, Giorgio Patrini. Más bien al contrario. Un deepfake de Emma Watson tiene 23 millones de vistas en Xvideos, Xnxx y xHamster, tres de los mayores sitios porno del mundo, cuya lógica de monetización consiste en la derivación de tráfico masivo a contenidos pagos.

Entre las especulaciones más retorcidas se cuenta el cruce entre deepfakes y realidad virtual, donde personas reales (celebrities o no) puedan cobrar vida como esclavas sexuales virtuales de un usuario. No debería ser la preocupación principal para sociedades como las latinoamericanas, donde ni siquiera está garantizado el acceso a Internet. Pero los últimos años demuestran que el futuro nunca está demasiado lejos.

Nadie lo puede negar

Deepfake no es cualquier tipo de edición de video, sino la aplicación de una tecnología específica para un fin específico: deep learning (aprendizaje profundo) en un registro falso. A su vez, el deep learning no es cualquier tipo de inteligencia artificial. Según la definición del libro homónimo de Ian Goodfellow (2014), Deep Learning busca «resolver las tareas que son fáciles de realizar por un humano pero difíciles de describir formalmente». Por ejemplo, reconocer una imagen. El desarrollo de la informática fue en sentido contrario: ya en 1997, la computadora de IBM Deep Blue logró vencer al mejor ajedrecista vivo del mundo. Pero es mucho más reciente la capacidad de las computadoras para interpretar un estado de ánimo, distinguir a un perro de un gato o directamente «hablar», tareas que cualquier ser humano silvestre puede realizar sin entrenamiento específico. La ironía está encerrada en algunos captcha: «Demuestre que es un humano identificando este semáforo». Qué gran habilidad, señor humano. Felicitaciones.

Ian Goodfellow ya había causado revuelo entre sus colegas con su libro cuando ese mismo año ideó el invento que lo colocó en el panteón global de las mentes fundamentales de la inteligencia artificial: las redes generativas antagónicas (GAN, por sus siglas en inglés), un modelo algorítmico que posibilitó, entre otras cosas, la aparición de los deepfakes. El actual director de Machine Learning en Apple y ex investigador principal en Google Brain (quien todavía no cumplió 35 años) estaba tomando cerveza en un bar de Montreal mientras discutía con unos amigos sobre la capacidad de la inteligencia artificial para generar fotos realistas. El alcohol propulsó una idea que hubiera descartado bajo los efectos de la sobriedad.

Para que una red neuronal aprenda a crear una imagen no solo tiene que observar millones de imágenes sino saber si lo que haya creado está bien o mal. Para resolver este problema, Goodfellow propuso enfrentar a dos redes en una competencia: una red «generadora», entrenada para crear las imágenes, y una red «discriminadora», entrenada específicamente para detectar las diferencias entre una imagen real y otra creada artificialmente. A través de sucesivos rounds, las redes mejoran automáticamente los parámetros sobre los que cumplen su tarea. Y eventualmente, la red discriminadora ya no podrá detectar qué es real y qué falso. La teoría de Goodfellow se comprobó en la práctica y, entre otros usos menos publicitados, los deepfakes asomaron en los suburbios de internet.

El invento de Goodfellow entraña una lógica fáustica: serás capaz de crear lo real, pero ya no sabrás qué es lo real. En una entrevista con la MIT Technology Review, admite que no habrá solución técnica al problema de la autenticación, sino que será un requisito social educar y concientizar a la población sobre los peligros de esta tecnología y la posibilidad de que las imágenes que observamos pueden o no ser reales. «¿Cómo probarías que eres un humano y no un robot?», le preguntó Lex Fridman en su podcast. «De acuerdo a mi propia metodología de investigación no hay manera de saberlo a esta altura», respondió Goodfellow, quien desde su apellido (que significa «buen compañero») hasta su tono monocorde y precisión discursiva podría pasar por androide. «Probar que algo es real por su propio contenido es muy difícil. Somos capaces de simular casi cualquier cosa, así que habría que servirse de algo más allá del contenido para probar que algo es real», siguió Goodfellow.

La mala reputación de la simulación, sin embargo, no debería eclipsar su potencial: el testeo de drogas simuladas sobre órganos simulados, afectados por enfermedades simuladas; la experimentación subatómica para el desarrollo de energías alternativas; la proyección algorítmica de los viajes espaciales; aplicaciones industriales, agroalimentarias, e incluso artísticas. La mayoría de estas disciplinas requieren una capacidad computacional inmensa (y en ese terreno la mayor apuesta es la computación cuántica), pero lo interesante es la premisa que subyace. Goodfellow busca que las redes «comprendan el mundo en función de una jerarquía de conceptos, cada uno de ellos definidos a partir de conceptos más simples», provenientes de la experiencia.

Si las redes neuronales de inteligencia artificial continúan con este ritmo de aceleración, la humanidad tendrá a su disposición herramientas capaces de dislocar su experiencia con el mundo. Para siempre. A diferencia de otras tecnologías, la «democratización» no resolverá los dilemas que presentan los deepfakes. ¿A quién le reclamaremos la verdad? Quizás habrá que acostumbrarse a vivir sin ella.